O desvio padrão é provavelmente a medida mais citada em relatórios, artigos e apresentações de dados — e também uma das mais mal interpretadas. Muitas pessoas sabem que ele “mede dispersão”, mas não conseguem explicar o que isso significa de verdade, nem por que a fórmula tem aquela raiz quadrada.

Este post resolve isso de uma vez.

O problema que o desvio padrão resolve

Imagine dois grupos de alunos com a mesma nota média:

| Grupo | Notas | Média |

|---|---|---|

| A | 70, 70, 70, 70, 70 | 70 |

| B | 40, 55, 70, 85, 100 | 70 |

A média é idêntica, mas os grupos são completamente diferentes. No grupo A, todos tiraram exatamente 70. No grupo B, as notas variam de 40 a 100. Usar apenas a média para descrever esses grupos seria enganoso.

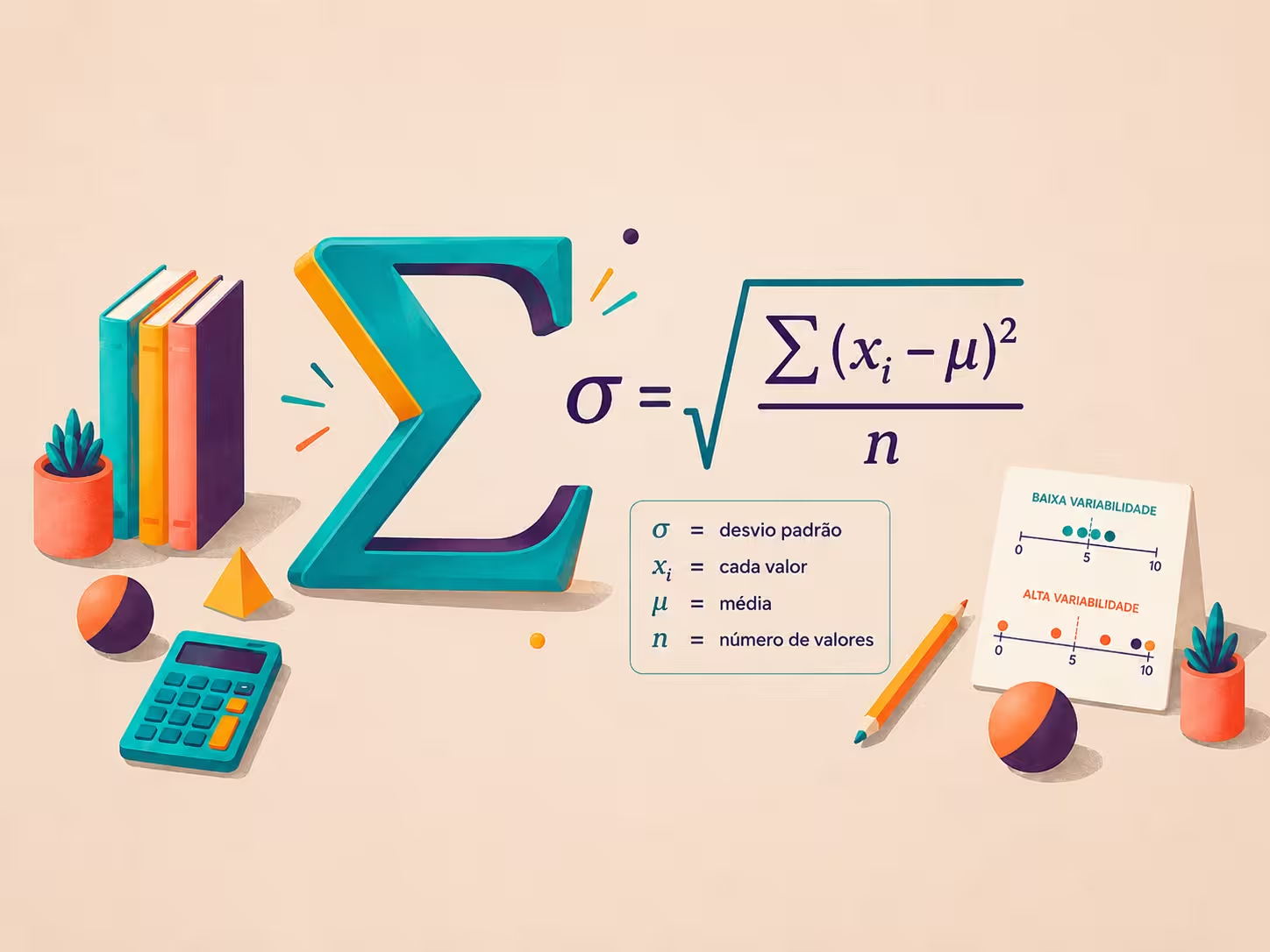

O desvio padrão mede o quanto os valores se afastam da média. Mais precisamente, ele é a raiz quadrada da média dos desvios ao quadrado — e não a média das distâncias absolutas (essa medida existe e se chama desvio absoluto médio). A distinção será explorada na próxima seção.

Da ideia intuitiva à fórmula

A ideia mais direta seria calcular a média das diferenças entre cada valor e a média. Para o grupo B acima (média = 70):

| Aluno | Nota (\(x_i\)) | Diferença (\(x_i - \bar{x}\)) |

|---|---|---|

| 1 | 40 | −30 |

| 2 | 55 | −15 |

| 3 | 70 | 0 |

| 4 | 85 | +15 |

| 5 | 100 | +30 |

| Soma | 0 |

O problema: as diferenças positivas e negativas sempre se cancelam, e a soma é zero para qualquer conjunto de dados. Isso não é útil.

Solução 1 — usar o valor absoluto:

\[\text{Desvio médio absoluto} = \frac{1}{n}\sum_{i=1}^{n} |x_i - \bar{x}|\]Essa medida existe e tem nome: chama-se desvio absoluto médio (DAM). Funciona, mas o valor absoluto tem propriedades matemáticas inconvenientes: não é diferenciável em zero, o que dificulta o uso em otimização e em teoria estatística mais avançada.

Solução 2 — elevar ao quadrado:

Elevar ao quadrado também elimina os sinais, mas usa operações algébricas padrão. O resultado é a variância:

\[\sigma^2 = \frac{1}{n}\sum_{i=1}^{n} (x_i - \mu)^2\]O único custo é que a variância está em unidades ao quadrado (por exemplo, notas² em vez de notas). Para voltar à unidade original, basta tirar a raiz quadrada — e esse é exatamente o desvio padrão.

A fórmula do desvio padrão

Existem duas versões, dependendo do contexto.

Desvio padrão populacional

Usado quando você tem todos os dados do grupo de interesse (a população inteira):

\[\sigma = \sqrt{\frac{1}{N}\sum_{i=1}^{N} (x_i - \mu)^2}\]Onde:

- $N$ é o número total de elementos da população

- $\mu$ é a média da população

- $x_i$ é cada valor individual

Desvio padrão amostral

Usado quando você tem apenas uma amostra e quer estimar a dispersão da população:

\[s = \sqrt{\frac{1}{n-1}\sum_{i=1}^{n} (x_i - \bar{x})^2}\]Onde:

- $n$ é o tamanho da amostra

- $\bar{x}$ é a média da amostra

A única diferença está no denominador: $N$ na versão populacional e $n - 1$ na amostral. A razão dessa diferença — o famoso denominador $n - 1$ — merece uma explicação própria.

Por que $n - 1$ e não $n$?

Se você usa $\bar{x}$ (a média da amostra) no lugar de $\mu$ (a média da população), já está cometendo um pequeno erro: $\bar{x}$ é calculado a partir dos mesmos dados que estão sendo usados para medir a dispersão. Isso cria uma dependência que tende a subestimar a variabilidade real da população.

A correção matemática exata é dividir por $n - 1$ em vez de $n$. Esse ajuste é chamado de correção de Bessel, e garante que $s^2$ seja um estimador não viesado de $\sigma^2$ — ou seja, que em média (sobre muitas amostras possíveis) o estimador acerte o valor verdadeiro.

Outra forma de pensar: ao calcular $\bar{x}$, você “consome” 1 grau de liberdade dos dados. Dos $n$ valores, apenas $n - 1$ podem variar livremente depois que a média é fixada — o último valor fica determinado pelos demais. Por isso, divide-se por $n - 1$, não por $n$.

Detalhe: $s^2$ é não viesado, mas $s$ não é

A variância amostral $s^2$ é um estimador não viesado de $\sigma^2$: $E(s^2) = \sigma^2$. No entanto, o desvio padrão amostral $s$ não é exatamente não viesado para $\sigma$: em geral, $E(s) \neq \sigma$. Isso decorre da não-linearidade da raiz quadrada (desigualdade de Jensen). Na prática, para amostras médias ou grandes, o viés de $s$ é pequeno e geralmente ignorado.

Quando usar cada versão?

- $\sigma$ (populacional): quando você tem os dados de toda a população — por exemplo, as notas de todos os alunos de uma turma específica que você quer descrever, sem pretensão de generalizar.

- $s$ (amostral): quando você quer estimar a dispersão de uma população maior a partir de uma amostra — situação muito mais comum na prática.

Cálculo passo a passo

Vamos calcular o desvio padrão amostral das notas do grupo B: 40, 55, 70, 85, 100.

Passo 1 — calcule a média amostral $\bar{x}$:

\[\bar{x} = \frac{40 + 55 + 70 + 85 + 100}{5} = \frac{350}{5} = 70\]Passo 2 — calcule cada desvio ao quadrado $(x_i - \bar{x})^2$:

| \(x_i\) | \(x_i - \bar{x}\) | \((x_i - \bar{x})^2\) |

|---|---|---|

| 40 | −30 | 900 |

| 55 | −15 | 225 |

| 70 | 0 | 0 |

| 85 | +15 | 225 |

| 100 | +30 | 900 |

| Soma | 2250 |

Passo 3 — calcule a variância amostral $s^2$:

\[s^2 = \frac{2250}{5 - 1} = \frac{2250}{4} = 562{,}5\]Passo 4 — tire a raiz quadrada:

\[s = \sqrt{562{,}5} \approx 23{,}72\]A raiz quadrada não é um detalhe algébrico: a variância $s^2 = 562{,}5$ está em pontos² — uma unidade sem interpretação direta no contexto de notas. A raiz devolve a medida para a escala original dos dados, resultando em pontos.

Interpretação: o desvio padrão das notas do grupo B é de 23,72 pontos. Compare com o grupo A, onde o desvio padrão é zero — todas as notas são iguais à média.

Desvio padrão e variância: qual a diferença?

Variância e desvio padrão medem a mesma coisa, mas em escalas diferentes:

| Variância (\(\sigma^2\) ou \(s^2\)) | Desvio padrão (\(\sigma\) ou \(s\)) | |

|---|---|---|

| Unidade | Unidade original ao quadrado | Mesma unidade dos dados |

| Vantagem | Propriedades algébricas convenientes | Diretamente comparável aos dados |

| Uso típico | Cálculos teóricos, ANOVA, regressão | Comunicação de resultados, intervalos de confiança |

Na prática, o desvio padrão é preferido para comunicação porque está na mesma unidade dos dados. A variância é mais usada internamente em derivações matemáticas.

Propriedades importantes

1. O desvio padrão é sempre não negativo

\[\sigma \ge 0 \qquad s \ge 0\]É igual a zero somente quando todos os valores são idênticos.

2. Não é resistente a valores extremos

Um único valor muito afastado da média pode aumentar drasticamente o desvio padrão. Para dados com outliers marcantes, o intervalo interquartil (IQR) é uma alternativa mais robusta.

3. Efeito de transformações lineares

Se você transformar os dados pela operação $Y = aX + b$, o desvio padrão de $Y$ será:

\[\sigma_Y = |a| \cdot \sigma_X\]O deslocamento $b$ (somar ou subtrair uma constante) não altera a dispersão. A escala $a$ (multiplicar por uma constante) afeta o desvio padrão proporcionalmente, mas sem elevar ao quadrado.

4. Soma de variáveis independentes

Se $X$ e $Y$ são variáveis aleatórias independentes:

\[\text{Var}(X + Y) = \text{Var}(X) + \text{Var}(Y)\] \[\sigma_{X+Y} = \sqrt{\sigma_X^2 + \sigma_Y^2}\]Note que as variâncias somam, não os desvios padrão. Somar desvios padrão diretamente seria um erro comum.

O coeficiente de variação

O desvio padrão tem uma limitação: seu valor depende da escala dos dados. Um desvio de 5 kg numa pesagem de elefantes é desprezível; o mesmo desvio de 5 g numa pesagem de joias é enorme.

Para comparar dispersões em escalas diferentes, usa-se o coeficiente de variação (CV):

\[CV = \frac{s}{\bar{x}} \times 100\%\]O CV expressa o desvio padrão como percentual da média, tornando-o comparável entre conjuntos de dados com unidades ou ordens de grandeza distintas.

Referência prática (aproximada):

| CV | Interpretação |

|---|---|

| Até 15% | Baixa dispersão |

| 15% a 30% | Dispersão moderada |

| Acima de 30% | Alta dispersão |

Atenção

O CV só é interpretável quando a média é positiva e os dados não incluem zero ou valores negativos. Em dados de temperatura em Celsius, por exemplo, a interpretação do CV pode ser enganosa.

Quando a média é próxima de zero, o CV pode crescer artificialmente e perder qualquer significado prático. Quando a média é negativa, o CV pode apresentar sinal negativo, tornando a comparação entre grupos problemática. Use o CV apenas quando a média estiver bem distante de zero e for positiva.

Exemplo prático: comparando dois grupos

Um pesquisador mede o tempo de resposta (em milissegundos) de dois algoritmos, cada um executado 6 vezes:

- Algoritmo A: 210, 215, 212, 208, 214, 211

- Algoritmo B: 195, 230, 205, 240, 198, 232

Médias:

\[\bar{x}_A = \frac{1270}{6} \approx 211{,}7 \text{ ms} \qquad \bar{x}_B = \frac{1300}{6} \approx 216{,}7 \text{ ms}\]Desvios padrão (amostral):

\[s_A \approx 2{,}7 \text{ ms} \qquad s_B \approx 19{,}4 \text{ ms}\]Coeficientes de variação:

\[CV_A \approx 1{,}3\% \qquad CV_B \approx 9{,}0\%\]O algoritmo A é ligeiramente mais rápido em média — menor tempo de resposta implica maior velocidade — e muito mais consistente. O algoritmo B apresenta maior tempo médio de resposta e variabilidade substancialmente maior: cerca de sete vezes o desvio padrão do A. A diferença de 5 ms na média pode parecer pequena, mas a instabilidade do B (desvio de quase 20 ms) costuma ser o fator decisivo em aplicações sensíveis a latência.

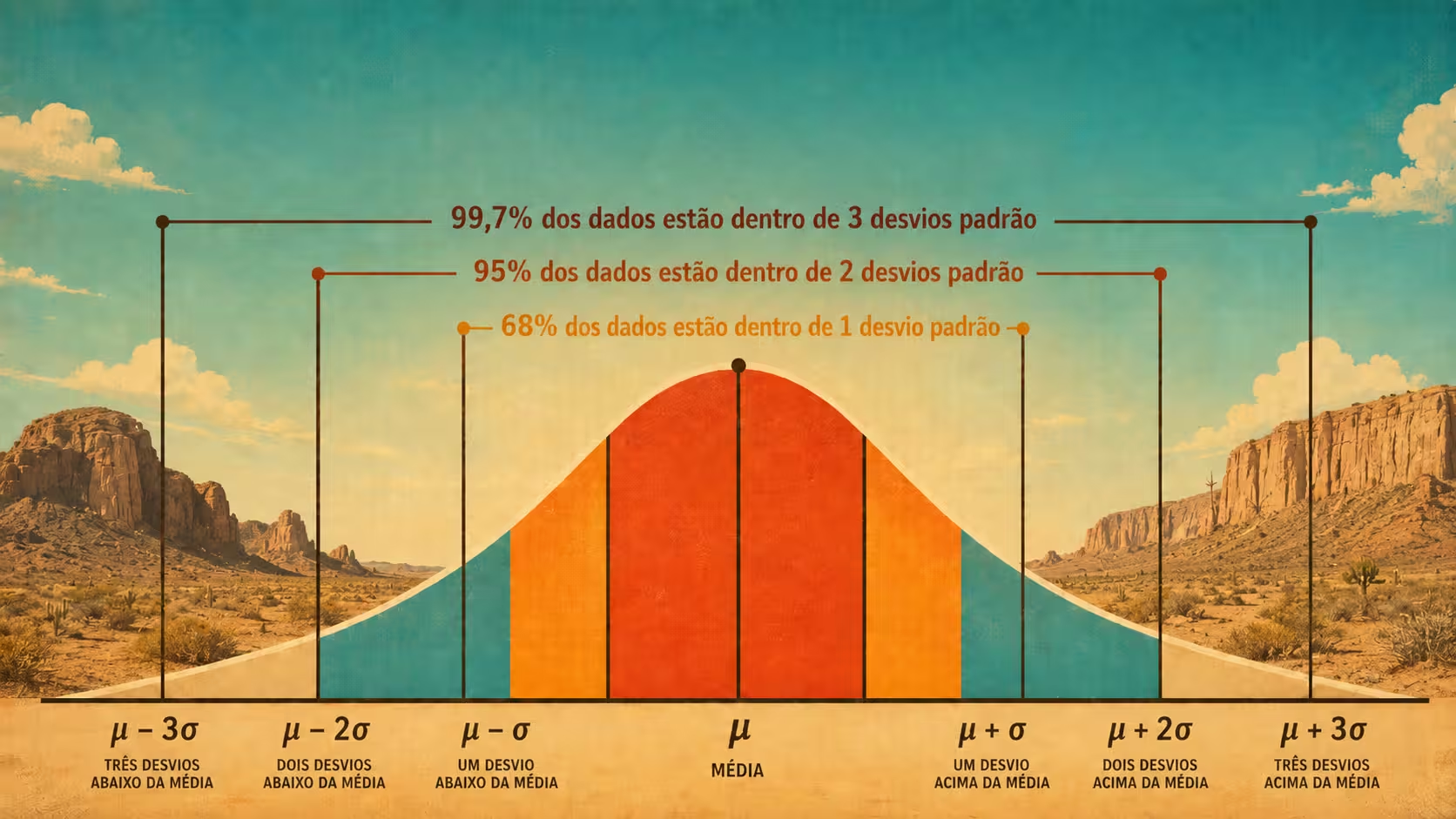

A conexão com a distribuição normal

Quando os dados seguem uma distribuição normal, o desvio padrão ganha um significado preciso graças à regra 68–95–99,7:

\[P(\mu - \sigma \le X \le \mu + \sigma) \approx 68{,}27\%\] \[P(\mu - 2\sigma \le X \le \mu + 2\sigma) \approx 95{,}45\%\] \[P(\mu - 3\sigma \le X \le \mu + 3\sigma) \approx 99{,}73\%\]

Isso significa que, numa distribuição normal, saber a média e o desvio padrão é suficiente para descrever completamente a distribuição — e calcular probabilidades para qualquer intervalo.

Fora da normalidade, o Teorema de Chebyshev oferece uma garantia mais fraca, mas válida para qualquer distribuição: para qualquer $k > 1$, pelo menos $1 - 1/k^2$ dos valores estão dentro de $k$ desvios padrão da média.

O escore Z: padronizando com o desvio padrão

O desvio padrão é a unidade natural para medir o “quão distante” uma observação está da média. Essa ideia se formaliza no escore Z (ou valor padronizado):

\[z_i = \frac{x_i - \bar{x}}{s}\]O escore Z indica quantos desvios padrão a observação $x_i$ está acima (se positivo) ou abaixo (se negativo) da média.

Exemplo com os dados do grupo B ($\bar{x} = 70$, $s \approx 23{,}72$):

A nota $x = 100$ corresponde ao escore:

\[z = \frac{100 - 70}{23{,}72} \approx 1{,}26\]A nota 100 está aproximadamente 1,26 desvios padrão acima da média. Já a nota $x = 40$:

\[z = \frac{40 - 70}{23{,}72} \approx -1{,}26\]A nota 40 está 1,26 desvios padrão abaixo da média — simetricamente oposta à nota 100, como esperado.

O escore Z é útil para:

- Comparar observações de diferentes distribuições — por exemplo, a nota em Matemática e a nota em Português, que têm médias e desvios padrão distintos.

- Identificar valores atípicos — escores com z > 2 são incomuns em distribuições normais (ocorrem em cerca de 5% dos casos); com z > 3, são raros (0,3%).

- Padronizar variáveis antes de algoritmos de aprendizado de máquina sensíveis à escala, como regressão com regularização e k-NN.

Quando a variável segue uma distribuição normal, o escore Z permite consultar a tabela Z para calcular probabilidades de intervalos — conforme explorado no post sobre distribuição normal.

Erros comuns

Confundir desvio padrão com erro padrão. O desvio padrão ($s$) descreve a variabilidade dos dados individuais. O erro padrão ($SE = s/\sqrt{n}$) descreve a variabilidade da média amostral — ele diminui conforme o tamanho da amostra aumenta. São medidas diferentes para propósitos diferentes.

Somar desvios padrão. Ao somar variáveis aleatórias independentes, as variâncias somam ($\text{Var}(X + Y) = \text{Var}(X) + \text{Var}(Y)$), mas os desvios padrão não se somam diretamente. Para combinar grupos de dados (por exemplo, juntar turma A e turma B num único conjunto), somar variâncias também não basta — é preciso levar em conta os tamanhos dos grupos e a diferença entre as médias. A variância do conjunto combinado de dois grupos é:

\[s_{\text{comb}}^2 = \frac{(n_1 - 1)s_1^2 + (n_2 - 1)s_2^2 + n_1(\bar{x}_1 - \bar{x})^2 + n_2(\bar{x}_2 - \bar{x})^2}{n_1 + n_2 - 1}\]onde $\bar{x}$ é a média ponderada dos dois grupos.

Usar o desvio padrão para distribuições muito assimétricas. Em distribuições com assimetria forte, como renda ou preços de imóveis, a média e o desvio padrão podem ser pouco informativos. Prefira a mediana e o IQR nesses casos.

Resumo das fórmulas

| Medida | Fórmula | Uso |

|---|---|---|

| Variância populacional | \(\sigma^2 = \dfrac{1}{N}\displaystyle\sum(x_i - \mu)^2\) | Quando se tem a população inteira |

| Variância amostral | \(s^2 = \dfrac{1}{n-1}\displaystyle\sum(x_i - \bar{x})^2\) | Quando se tem uma amostra |

| Desvio padrão populacional | \(\sigma = \sqrt{\sigma^2}\) | Descrição da população |

| Desvio padrão amostral | \(s = \sqrt{s^2}\) | Estimação e inferência |

| Coeficiente de variação | \(CV = \dfrac{s}{\bar{x}} \times 100\%\) | Comparação entre escalas diferentes |

Calculando na prática: código em Julia

using Statistics

dados = [40, 55, 70, 85, 100]

media = mean(dados)

variancia_amostral = var(dados) # denominador n − 1

desvio_amostral = std(dados) # denominador n − 1

println("Média = ", media)

println("Variância amostral = ", variancia_amostral)

println("Desvio padrão amostral = ", round(desvio_amostral, digits=2))Saída esperada:

Para a versão populacional (denominador $N$):

n = length(dados)

variancia_pop = sum((dados .- mean(dados)).^2) / n

desvio_pop = sqrt(variancia_pop)

println("Variância populacional = ", variancia_pop)

println("Desvio padrão populacional = ", round(desvio_pop, digits=2))Saída esperada:

Note que a variância populacional ($450{,}0$) é menor do que a amostral ($562{,}5$), pois divide por $N = 5$ em vez de $n - 1 = 4$.

Referências

- Casella, George; Berger, Roger L. Statistical Inference. 2. ed. Duxbury Press, 2002.

- Montgomery, Douglas C.; Runger, George C. Applied Statistics and Probability for Engineers. 6. ed. Wiley, 2014.

- Freedman, David; Pisani, Robert; Purves, Roger. Statistics. 4. ed. W. W. Norton & Company, 2007.

- Bessel, Friedrich Wilhelm. Untersuchungen über die Wahrscheinlichkeit der Beobachtungsfehler. 1838.